Başka bir gün, AI’dan başka bir hıçkırık. Bu sefer, Apple Intelligence’ın oldukça büyük bir hata yapmasının ardından Apple pek de dostane olmayan bir dürtmeyle karşı karşıya. iOS 18.1, iPadOS 18.1 ve macOS Sequoia 15.1 ile başlatılan Apple Intelligence, diğer özelliklerin yanı sıra bildirim özetleri gibi yapay zeka destekli araçları da beraberinde getiriyor.

Bunlar arasında konuşmak yerine Siri’ye sorgu yazma, bir fotoğraf temizleme aracı, e-posta özetleri, özel emojiler için Genmoji, fotoğraflardan görseller oluşturmaya yönelik bir görüntü oyun alanı ve iPhone 16’da gelişmiş görüntü tanıma için görsel zeka yer alıyor.

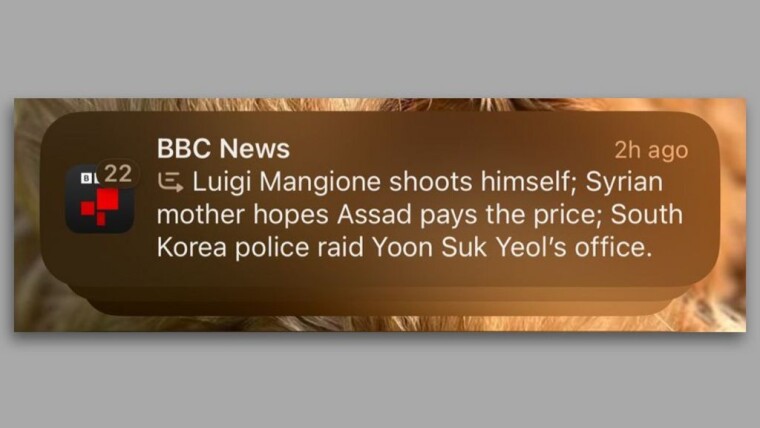

Sorun, yapay zekanın iOS cihazlarda BBC News uygulamasından gelen bildirimleri özetlemesiyle başladı. Özetlerden biri yanlışlıkla Luigi Mangione’nin kendini vurduğunu bildirdi. Ama olay şu: bu doğru değildi. Yapay zeka yanlış anladı.

Şimdi bu konuyla ilgili bağlam vermek için bir saniyeliğine geriye gidelim. UnitedHealthcare’in CEO’su Brian Thompson bu ayın başlarında trajik bir şekilde öldürüldü. Ölümü, özellikle de katili olduğu iddia edilen Luigi Mangione’nin tutuklanmasından sonra büyük ilgi gördü.

Mangione’nin adı haberlerde yoğun bir şekilde yer aldı, ancak yapay zeka manşetleri yanlış yorumlayarak oluşturduğu özette ciddi bir karışıklık yarattı. Bu sadece basit bir yazım hatası ya da küçük bir hata değildi; haberlerin sunuluş biçimindeki önemli bir hataydı; kullanıcılar arasında kolayca kafa karışıklığına ve hatta paniğe yol açabilecek bir hataydı.

Bu gafın ardından BBC, Apple’a şikayette bulundu. Artık Sınır Tanımayan Gazeteciler (RSF) ağırlık verdiApple’ı Apple Intelligence bildirim özelliğini tamamen devre dışı bırakmaya çağırıyor. RSF, olayı yapay zekanın hassas bilgilerin işlenmesindeki sınırlamalarının kanıtı olarak gösterdi. Bir açıklamada şunları söylediler:

Bu kaza, yapay zeka sistemlerinin, gazetecilik kaynaklarına dayansa bile kaliteli bilgileri sistematik olarak yayınlama konusundaki yetersizliğini vurguluyor. Yapay zeka sistemlerinin olasılığa dayalı çalışma şekli, onları genel halka yönelik çözümlerde kullanılabilecek haber medyası için güvenilir bir teknoloji olarak otomatik olarak diskalifiye eder.

Habere konu olan tek yapay zeka hatası bu değil. Bu yılın başlarında Google’ın sohbet robotu Gemini’nin Kurucu Babalar, Nazi askerleri ve Vikingler gibi diğer ırklar gibi tasvir edilen beyaz tarihi figürlerin görüntülerini üretmesiyle yapay zeka tarafından oluşturulan görüntüler tartışmalara yol açtı. Ayrıca “mutlu beyaz insanlar” ve “ideal çekirdek aile” gibi yönlendirmeleri de reddetti. Google daha sonra “işareti kaçırdığı” için özür diledi ve Gemini’de insan resimlerinin oluşturulması geçici olarak engellendi.